Codecs et gestion de qualité de service : Téléphonie IP

V.3 Les Codecs

Codec est construit d’après les mots codeur et décodeur, et fait souvent appel à la COmpression et DÉCompression des données.

Il s’agit d’un procédé permettant de compresser et de décompresser un signal, de l’audio ou de la vidéo, le plus souvent en temps réel, permet une réduction de la taille du fichier original.

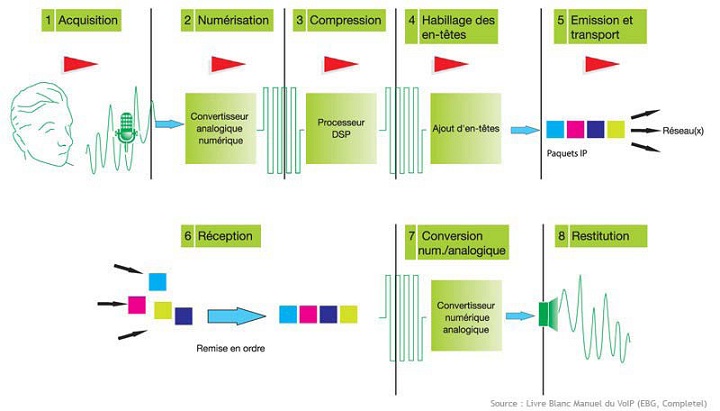

Le codec numérise et compresse la voix de l’émetteur, ainsi les données numériques sont encapsulées dans des paquets IP et acheminées vers le destinataire.

A l’arrivés au destinataire, ce dernier grâce au même codec décompresse et restitue le son (voir figure 7).

Figure 7: Déroulement d’une conversation

L’utilisation d’un format numérique est une réponse aux limitations liées aux lignes analogiques.

En effet, la qualité sonore d’un signal analogique se dégrade énormément avec la distance et est fortement perturbée par la présence de bruit sur la ligne.

La conversion au format numérique d’une source audio se réalise par l’échantillonnage grâce au DSP (Digital Signal Processor).

Le rôle du DSP est de prendre à intervalle constant la valeur du signal analogique et de lui associer un nombre exprimé en binaire (chaque nombre est composé d’une suite de 1 et de 0).

Ainsi un nombre binaire composé par exemple de 4 bits permet d’exprimer 16 nuances de sons différentes.

Chaque signal musical ou de parole est donc codé à l’aide d’une suite finie de nombres.

Quelques exemples de fréquences d’échantillonnage (le nombre d’intervalles dans une seconde) sont:

- • 44100 Hz: qualité CD,

- • 22000 Hz: qualité radio,

- • 8000 Hz: qualité téléphone.

Après l’échantillonnage, la séquence de nombres représentant le flux audio est convertie sous un format compressé afin de limiter le débit d’information à transmettre.

Il existe différents algorithmes de compression et décompression, appelés aussi COdage-DECodage.

En téléphonie, c’est la branche ITU-T de l’organisme International Télécommunications qui standardise les CODECs dans sa série de recommandations G-XXX.

Par exemple :

- G.711: technique de codage compressé dont le débit du flux est de 64 Kbit/s,

- G.721: technique de codage compressé dont le débit du flux est de 32 Kbit/s,

- G.728: technique de codage compressé dont le débit du flux est de 16 Kbit/s,

- G.729: série de techniques de codage compressé dont le débit des flux est de 8 Kbit/s.

Pour un réseau téléphonique, c’est le CODEC G.711 qui est utilisé.

Une fois compressée, une conversation téléphonique donne lieu à un débit de 64 Kbit/s par canal (un pour l’émission et un pour la réception).

V.4 Gestion de la qualité de service

Il y a quelques années chaque type de trafic, voix, données, etc., avait son propre réseau, dédié et taillé sur mesure.

Aujourd’hui les différents flux sont regroupés sur un seul et même support que constituent les réseaux IP.

Les débits ne cessent donc de grimper et les réseaux sont désormais multiservices.

Cette centralisation simplifie grandement les tâches des administrateurs et utilisateurs car il n’y a plus qu’une seule infrastructure à gérer.

Cependant, sans régulation du trafic, les réseaux IP se retrouvent vite saturés.

La multiplication des flux provoque l’engorgement des liaisons, il faut donc faire la police pour fluidifier la circulation.

Afin de pouvoir assurer un niveau de service satisfaisant pour les utilisateurs et améliorer les performances d’un réseau, il convient d’envisager une notion nouvelle: la Qualité de Service (QoS).

V.4.1 Problèmes liés à la qualité de service

** Gestion de la bande passante

Sur le réseau WAN (Wide Area Network) de l’entreprise, la ressource en bande passante est bien plus contrainte que sur le LAN.

Une application gourmande en bande passante, telle qu’une application de messagerie ou de transfert de fichiers, peut donc rapidement compromettre la qualité de service (QoS) des applications critiques, comme les progiciels de gestion intégrés ou les bases de données.

Par exemple, une session FTP peut parfaitement monopoliser 100 % de la bande passante disponible; TCP fonctionnant en mode «premier arrivé premier servi», les autres applications n’ont plus alors qu’à attendre le téléchargement se termine pour retrouver une qualité de service normale.

Pour pallier ces inconvénients, accroître la bande passante disponible ne constitue pas toujours la bonne solution.

Une meilleure gestion de l’allocation de la bande passante disponible sera souvent bien plus efficace.

** Réduction de la latence

La latence est le temps mis par un paquet pour parcourir le trajet source – destination.

En mettant en application la QoS, la latence peut être réduite en donnant aux paquets appartenant aux clients les plus importants la priorité dans les files d’attentes des routeurs, de sorte que dès qu’un paquet prioritaire arrivera au routeur, il soit placé en tête dans la file d’attente de celui-ci.

Cependant ce procédé oblige les paquets avec une priorité moindre à une attente un peu plus longue, et de ce fait leur latence est plus grande encore qu’elle ne l’aurait été en suivant le modèle du » best effort «.

Les applications interactives sont sensibles à la latence du réseau, car une latence trop grande génère un retard de livraison des paquets.

Ces retards peuvent créer des disfonctionnements pour les utilisateurs et rendre certaines applications inutilisables (une conférence vidéo par exemple).

** Réduction de la Gigue

La Gigue (ou jitter) est définie de la façon suivante :

Gigue = | Latence (Pn) – Latence (Pn-1) | où Latence (Pi) est la latence du paquet numéro i, à son arrivée au destinataire.

En d’autres termes la gigue est la variation de latence constatée par le récepteur des paquets.

Par exemple, si une source envoie des paquets toutes les 30ms et que ceux-ci sont reçus par le récepteur à intervalles de 30ms, la gigue est de zéro.

Si la variance entre deux intervalles est différente de zéro, alors on dira que le réseau comporte une gigue.

Pour beaucoup d’applications une gigue élevée est encore pire qu’une latence même très forte, car cela introduit un facteur d’incertitude dans le flux de données.

** Réduction du nombre de paquets perdus

La perte de paquets force beaucoup d’applications et de protocoles à renvoyer des paquets qui ont été déjà envoyés.

Ceci retarde bien sur les transmissions, d’autant plus qu’un certain temps est nécessaire avant que la perte de paquets ne soit décelée.

Ainsi la perte de paquets est quelque chose dont personne ne veut mais qui est une réalité due aux tailles limitées des » buffers » sur le réseau.

Pendant les pics de transmission, certains noeuds sont obligés de rejeter des paquets si leurs buffers sont pleins et que de nouveaux paquets arrivent.

Une méthode pour éviter la perte de paquets serait de s’assurer qu’un noeud du réseau a la capacité d’envoyer des données plus rapidement qu’il ne les reçoit.

Cependant, ce n’est pas vraiment une option envisageable car elle serait trop onéreuse.

La perte de paquets peut être traitée de différentes manières par des applications et/ou des protocoles réseau.

• En utilisant TCP, des paquets perdus sont renvoyés par le protocole jusqu’à ce que le récepteur notifie que le paquet a bien été reçu.

• En utilisant cette méthode, le même paquet peut traverser des parties du réseau plusieurs fois. Une autre option serait l’utilisation d’UDP à la place de TCP et appliquer une autre méthode de traitement les paquets perdus.

** Applications agressives

En effet, quel que soit le réseau considéré, il existera toujours des applications au comportement plus agressif, à savoir occupant une grande partie de la bande passante, voire la totalité, en fonction de leurs besoins.

Généralement, même si elles sont importantes, ces applications ne sont pas urgentes (par exemple la réplication de base de données et la messagerie).

La majorité des applications des réseaux IP d’entreprise utilisent le protocole TCP (Transport Control Protocol) conçu pour octroyer un accès équitable à la bande passante du réseau.

V.4.2 Politique de mise en place d’une qualité de service

De la préparation au déploiement, on distingue trois étapes:

** Caractériser le trafic

Pour que l’administrateur ait une vue des flux circulant sur son réseau, un audit est indispensable.

Il peut être réalisé sur la totalité ou sur un sous-ensemble représentatif des liaisons du réseau.

Il sert à identifier les problèmes existants et à définir une politique de QoS qui tienne compte des éléments remontés lors de la phase d’étude.

** Classifier les flux

Selon les impératifs de l’entreprise, le responsable réseau définira une classification des divers flux et leur attribuera des niveaux de priorité.

Cette phase doit impérativement être menée en concertation avec les différents utilisateurs du système d’information.

** Définir les règles de traitement des flux

Selon la classification auparavant établie, le responsable réseau doit définir les règles de traitement des flux selon leur classe.

Il s’agit, par exemple, de déterminer les priorités de routage ou des niveaux de bande passante minimale pour certaines applications.

Avec l’architecture Diffserv(Differentiated Services), chaque classe de services est assortie d’un traitement spécifique en sortie du lien WAN.

V. ETAT DE L’ART SUR LA TELEPHONIE SUR IP

Etat de l’art sur la Téléphonie sur IP et les solutions logiciels libres – PREMIERE PARTIE

Etude et mise en place d’un système de communication de VoIP: Appliqué à un PABX IP open source